Límites éticos de la IA en el diagnóstico médico

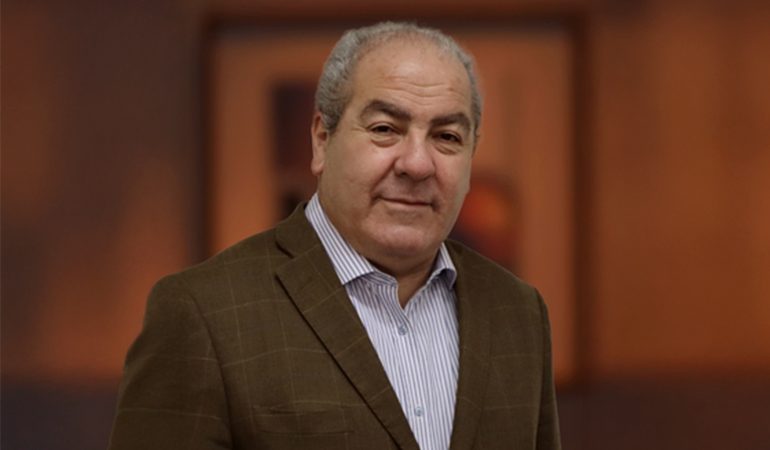

Dr. Luis Castillo Fuenzalida

Decano Facultad de Ciencias de la Salud

Universidad Autónoma de Chile

El desarrollo de la inteligencia artificial (IA) aplicada a la medicina plantea oportunidades inéditas. Algoritmos de aprendizaje profundo pueden detectar lesiones malignas en imágenes con un nivel de sensibilidad y especificidad comparable al de especialistas experimentados; e integrar múltiples variables clínicas y antecedentes facilitando un abordaje más preciso y personalizado de la enfermedad.

Sin embargo, plantea también interrogantes éticas profundas que amenazan con modificar la esencia de la relación médico-paciente.

La medicina no es sólo ciencia aplicada sino también un ejercicio de acompañamiento humano, empatía y responsabilidad profesional. La incorporación de esta tecnología en procesos diagnósticos, especialmente en áreas como radiología, dermatología y patología digital, puede tensionar aspectos centrales de la práctica clínica: la autonomía del paciente, la responsabilidad médica y la confianza en el vínculo terapéutico.

Desde el punto de vista del sistema de salud, representa una oportunidad para reducir errores diagnósticos, disminuir tiempos de espera y mejorar la eficiencia en el uso de recursos. No obstante, la sola capacidad técnica de la IA no garantiza su aplicación ética ni su aceptación social.

Uno de los primeros límites éticos se relaciona con la autonomía del paciente. Si bien la IA puede ofrecer recomendaciones basadas en datos, la decisión clínica sigue siendo un proceso complejo que involucra valores, preferencias y circunstancias personales. Delegar de manera acrítica el diagnóstico a un algoritmo corre el riesgo de despersonalizar la atención, reduciendo al paciente a un conjunto de datos.

Por otra parte, surge la interrogante sobre la responsabilidad en caso de error: ¿debe recaer en el médico que interpreta el resultado, en el desarrollador del algoritmo o en la institución que lo implementa? La ética clínica exige que la decisión última siempre esté en manos del profesional, quien debe integrar la información técnica con el juicio clínico y la comunicación empática.

Otro desafío central es la opacidad de muchos sistemas de IA. Modelos de aprendizaje profundo funcionan como “cajas negras”, dificultando la trazabilidad del proceso que lleva a un resultado diagnóstico. Esta falta de trasmisión de información atenta contra el principio de transparencia, esencial en la relación médico-paciente. Para mantener la confianza, el paciente tiene derecho a comprender, al menos en términos generales, cómo se ha llegado a una conclusión diagnóstica.

Si el médico no puede explicar de manera adecuada los resultados entregados por la IA, se erosiona la confianza en el vínculo terapéutico. De ahí la importancia de avanzar hacia algoritmos más interpretables y en protocolos que exijan validación clínica independiente.

Por otro lado, esta tecnología se entrena con bases de datos que no siempre representan la diversidad social, étnica y cultural de los pacientes. Ello puede generar sesgos en los diagnósticos, afectando especialmente a poblaciones históricamente marginadas. Desde una perspectiva ética, su implementación debe considerar la justicia distributiva y garantizar que no profundicen inequidades en salud.

El médico, al incorporar resultados de IA en su práctica, tiene el deber de evaluar críticamente su pertinencia y evitar una dependencia acrítica.

Más allá de los aspectos técnicos, el núcleo de la discusión es la preservación de la dimensión humana de la medicina. La escucha activa, la empatía y el acompañamiento en el sufrimiento no pueden ser reemplazados por una máquina. El riesgo es que la fascinación tecnológica reduzca al médico a un mero intermediario entre el algoritmo y el paciente, debilitando el carácter relacional y terapéutico de la medicina.

La IA ofrece un potencial transformador para el diagnóstico médico, pero su incorporación exige una reflexión ética rigurosa. El respeto por la autonomía del paciente, la transparencia en los procesos, la prevención de sesgos y la delimitación clara de responsabilidades son aspectos esenciales para resguardar la integridad de la práctica clínica.

El desafío principal no radica en la capacidad técnica de los algoritmos sino en la capacidad del sistema de salud para integrarlos de manera ética, equitativa y centrada en la persona. La relación médico-paciente, basada en la confianza y la empatía, debe seguir siendo el pilar de la medicina. En este marco, la IA debe concebirse como un apoyo valioso, pero nunca como sustituto del juicio clínico ni del vínculo humano.